金桔

金币

威望

贡献

回帖0

精华

在线时间 小时

|

第四次工业革命的开端没跑了。

无数的旧职业将消亡, 新职业诞生, 这就是工业革命.

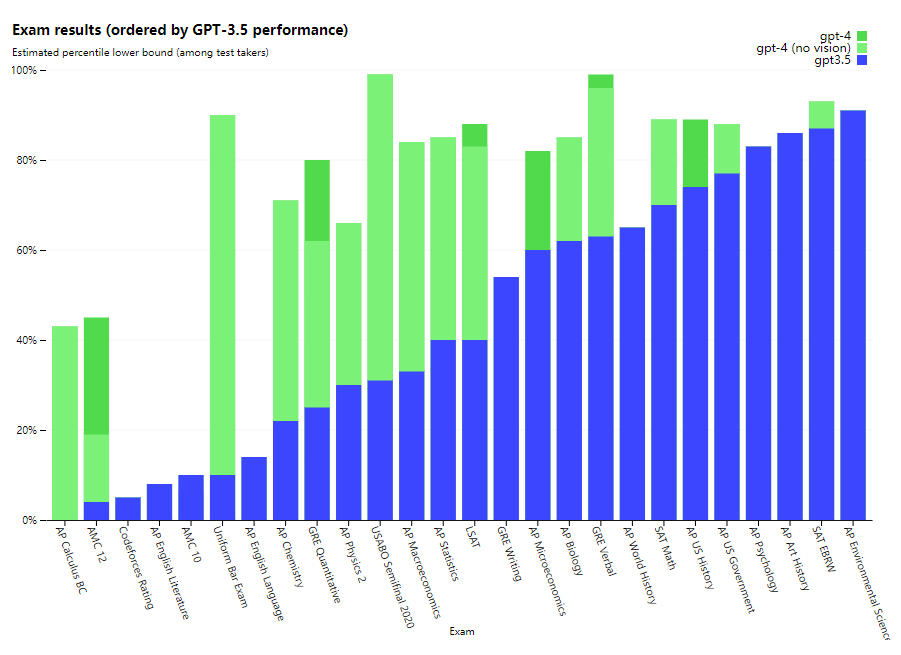

<hr/>第一部分考试就开幕雷击:

最左边那条, 先修微积分, 大致相当于国内同济高数上册.

提升幅度巨大, 实现了从零到一的突破, SAT Math 也有小幅提升.

之前几乎是零分, 被人嗤笑两位数加减乘除都不会.

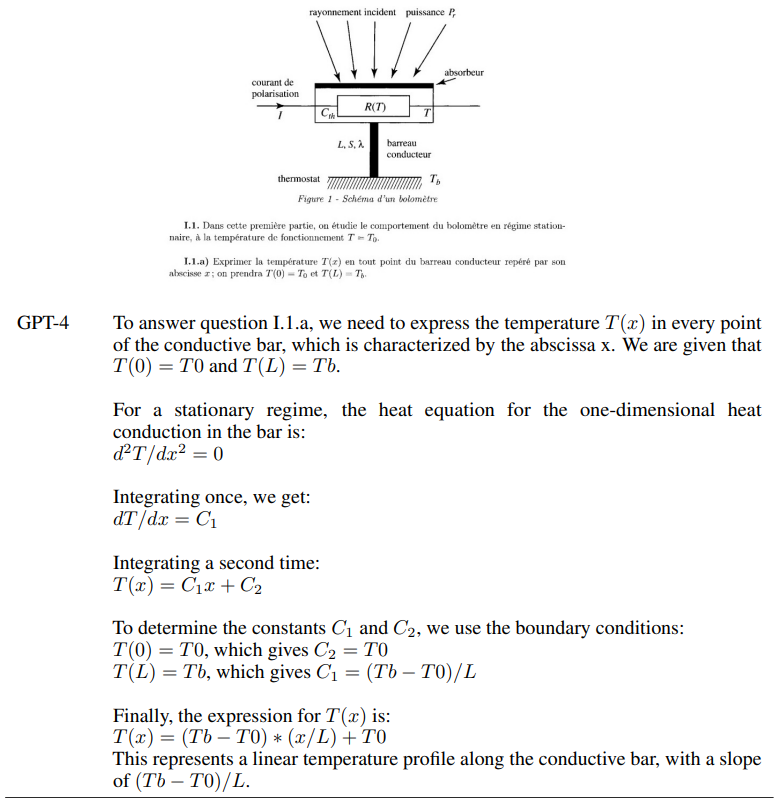

下面还有个看图一步步解物理题的, 看的我一愣一愣的, 这不就是拍照解题终极版.

很遗憾国内把拍照搜题技术给干掉了.

<hr/>第二个长绿条, 律师统考(Uniform Bar Exam), 统考不说有多关键吧, 也是重要门槛之一, 这就给你踏破了.

图里没有的, 但是也获得了满分的 AP 课程有, 宏观经济(AP Macroeconomics), 微观经济(AP Microeconomics), 生物(AP Biology), 心理(AP Psychology), 统计(AP Statistics)

也就是说, 完全能当一个优秀高中毕业生或者学废了的大学生用了.

这就引发了一个尖锐的问题, 那这些考试的意义是什么?

如果你按照这些考试的标准去招人, 其实还不如用 AI.

那你培养这些人的目的是什么? 毕业就让他们失业吗?

<hr/>

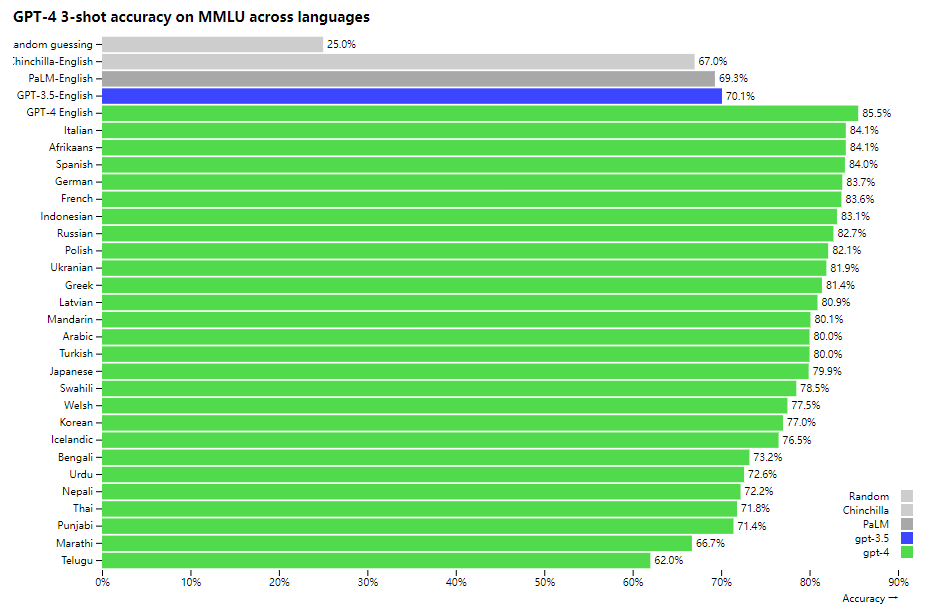

第二部分刷榜, 用硬实力告诉你这东西有多离谱, 没啥好说的.

第三部分还是刷榜, VQA 视觉问答任务, 跨界和别的 SOTA 对比, 单看数据没打赢

但是 0-shot 吊打别人 few shot, 啊这....

你知道谁喜欢卷 0-shot 吗? 自动驾驶...

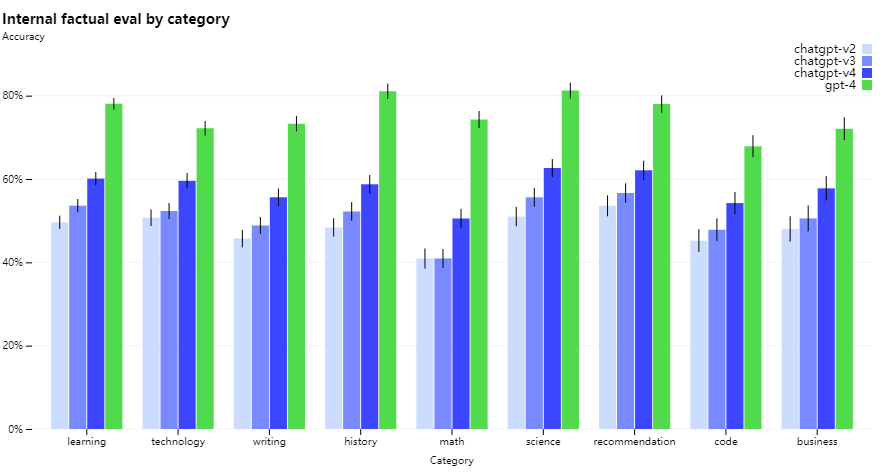

<hr/>第四部分, 改善了喜欢自信说出错误答案的问题.

用的词是显著改善(significantly reduces hallucinations), 后面测测是不是真的.

这部分非常感谢各位人类标记员, 笑..

所以国内的大模型得跟上啊, 多少人工多少智能, 人家几个亿的用户帮忙标注.

<hr/>后面是训练过程, 没啥用, 你按照这东西能训出来? |

|

/3

/3